För första gången har Googles cybersäkerhetsgrupp GTIG stött på vad som ser ut att vara en nolldagsattack skapad av AI. GTIG tror att AI är hjärnan på grund av det idiomatiska språkbruket och på grund av buggens natur. AI används allt mer offensivt, enligt GTIG.

För första gången har Googles cybersäkerhetsgrupp GTIG stött på vad som ser ut att vara en nolldagsattack skapad av AI. GTIG tror att AI är hjärnan på grund av det idiomatiska språkbruket och på grund av buggens natur. AI används allt mer offensivt, enligt GTIG.

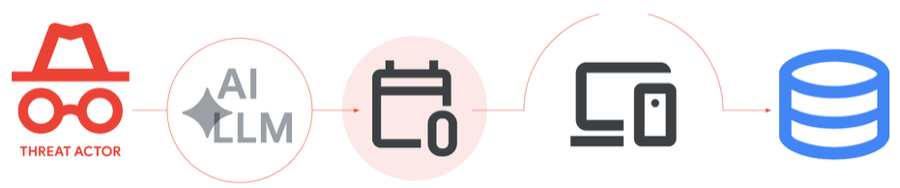

Följande utspelade sig någon gång mellan februari och maj, enligt en rapport från Googles cybersäkerhetsgrupp.

Det fanns en bugg i ett icke namngivet webbaserat adminstrationsverktyg: det gick att åsidosätta tvåfaktorsautentisering.

Någon hittade buggen – med hjälp AI. Samma någon – också med hjälp av AI – skrev ett pythonskript som gick till attack via buggen. Och planerade att sätta in skriptet i en bred attack mot adminstrationsverktyget.

Då red GTIG (Google Threat Intelligence Group) in som kavalleriet i sista minuten och informerade projektet, så att buggen kunde lagas.

Det som är anmärkningsvärt är att det var AI som både hittade buggen och skapade en attack som utnyttjade koden. Det är första gången som GTIG säger sig ha sett detta.

Att AI var hjärnan bakom kvalificerar GTIG med ett ”troligen”.

Det kallas för en ”nolldagsattack” – eftersom sårbarheten varit allmänt känd i noll dagar när den användes. Nolldagsattacker får just nu uppmärksamhet på grund av att amerikanska AI-jätten Anthropic presenterat en agent baserad på sin LLM Mythos, och den ska sitta på en oöverträffad förmåga att hitta och utnyttja nolldagssårbarheter.

Enligt Antropic väntar en våg av AI-skapade cyberattacker – om mellan ett halvår och ett år, då andra LLM:er hunnit ikapp Mythos.

GTIG:s fynd visar att det inte stämmer. Det finns inget andrum på sex månader. AI-attacker sker redan nu.

Vilken LLM som var hjärnan bakom attacken skriver GTIG inget om. Bara att det troligen inte var Googles egen Gemini.

GTIG ser spåren efter AI i det överdrivet pedagogiska språket och på att pythonkoden följer konventioner som man ofta ser i AI-genererad kod.

Och så fanns där en hallucination.

Enligt GTIG är buggen dessutom av ett slag som AI-buggbottar tros vara duktiga på att hitta, och som andra buggverktyg som fuzzing och klassisk statisk kodanalys är svaga på.

FAKTAAI används mer och mer för cyberattacker

Mellan sin förra rapport i februari och sin nya rapport har GTIG sett en trend: att användandet av offensiv generativ AI ökar och blir mer och mer systematiskt. AI används på flera olika sätt genom cyberattackens hela livscykel. GTIG kallar det för ”AI-relaterad hotaktivitet”. AI används inte bara för hitta buggar utan även för att skapa program som utnyttjar buggarna. Och för att producera sofistikerad offensiv programvara. Och för reverse engineering. Och för att skapa flexibla cyberattacker som dynamiskt anpassar sig själva efter hur attacken möts. Och så används AI för att generera media. Från Ryssland, Iran, Kina och Saudiarabien kommer AI-genererad politisk satir och berättelser som för fram specifika narrativ över både digitala plattformar och på tryckta affischer. AI skapar även fejkade klipp med klonade röster från verkliga journalister, eller klipp som på andra sätt kopplar innehållet till en avsändare med allmän trovärdighet. Experiment med att utnyttja verktyg som Openclaw och Oneclaw pågår. Aktörer skaffar sig till råga på allt fria AI-resurser för sitt utvecklingsarbete genom att kringgå begränsningar i användningen av AI-tjänsterna. En sak till: AI-miljöer i sig har blivit populära angreppspunkter för attacker mot leveranskedjor. Inte bara bottarna och agenterna angrips utan även deras protokoll och de verktyg som ingår i deras verktygsväskor. Även försvarssidan använder AI. GTIG meddelar att det använder sin egen AI – Big Sleep, Gemini och Codemender – för att leta och åtgärda buggar i sin egen kod. – Det demonstrerar att AI även kan vara ett kraftfullt verktyg för försvarare, skriver GTIG. Enligt GTIG är Kina och Nordkorea just nu mycket intresserade av att använda AI offensivt. De är dessutom avancerade aktörer. Även inbyggda system är mål. Just nu fiskar cyberspionagegruppen UNC2814 efter sårbarheter i mjukvaran till kineska TP-Links nätverksprodukter – med Googles egen AI-bott Gemini som ofrivillig konsult. En annan hotaktör har setts analysera en kinesisk databas med över 85 000 sårbarheter – för att träna en egen modell att hitta ännu fler sårbarheter. Även Nordkoreanska APT45 har setts analysera sårbarhetsrapporter. I GTIG:s rapport (länk) finns fler exempel på hur aktörer utnyttjar AI offensivt. Och tips på försvar. |