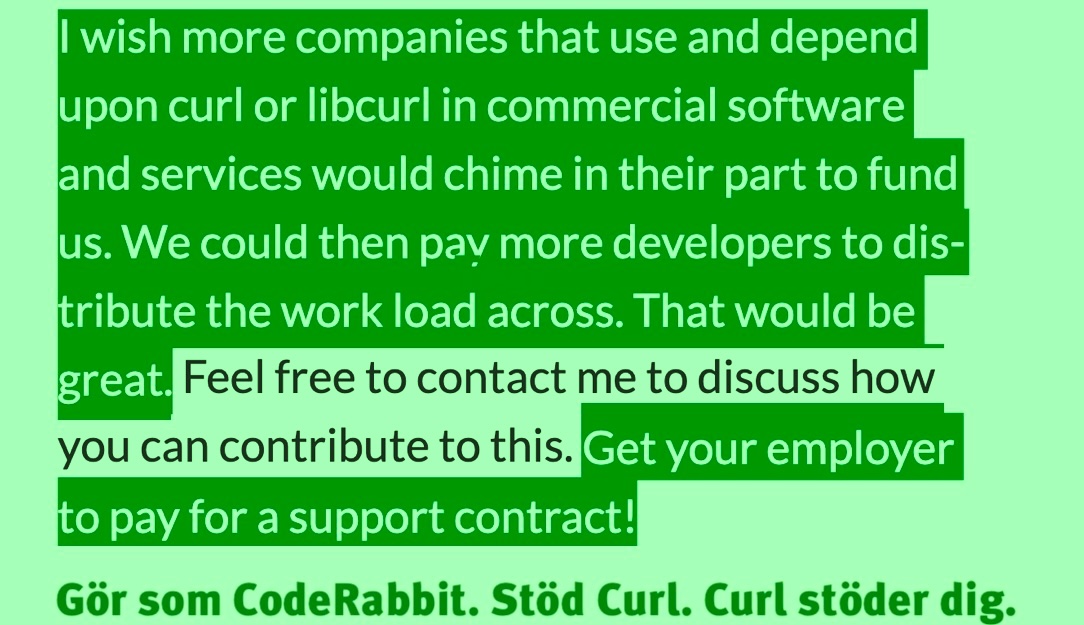

Strategiskt placerade tejpbitar på en stoppskylt gjorde att AI-systemet uppfattade den som en hastighetsskylt. Attacken är mer robust än tidigare attacker genom att den bygger på att skylten i sig manipuleras, och detta på ett förhållandevis enkelt sätt.

Strategiskt placerade tejpbitar på en stoppskylt gjorde att AI-systemet uppfattade den som en hastighetsskylt. Attacken är mer robust än tidigare attacker genom att den bygger på att skylten i sig manipuleras, och detta på ett förhållandevis enkelt sätt.

Flera leverantörer, bland dem Continental, Autoliv och Delphi, erbjuder idag förarassistensfunktionen Road Sign Detection som letar efter och identifierar vägskyltar vid vägkanten. Systemen används i bilar från minst 15 tillverkare, bland dem Volvo.

Forskare har nu visat att det teoretiskt går att lura sådana system genom att fysiskt ändra utseendet på vägskylten. I alla fall om de bygger på AI-tekniken deep learning.

|

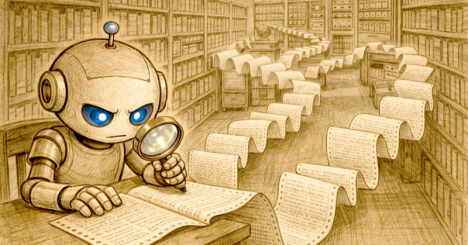

| Till vänster ser AI-systemet en skylt för påbjuden körriktning. Till höger ser systemet en stoppskylt. I bilden överst uppfattas de manipulerade stoppskyltarna som hastighetsgränser på 45 mph. |

I ett experiment maskerade de en stoppskylt så att den i bilens ögon såg ut som en hastighetsgräns i samtliga testbilder. Samma framgång hade de i ett försök att maskera en skylt för påbjuden körriktning så att den uppfattades som en stoppskylt.

Skyltarna maskerades med tejpbitar eller genom att manipulerade bilder printades ut och fästes över skyltarna.

Maskeringen fungerade även om vägskylten fotograferades på olika avstånd och ur olika vinklar.

Först tog forskarna fram en egen algoritm för bildanalys av vägskyltar med hjälp av standardmetoder inom AI-området deep learning. Därefter identifierade de akilleshälar i den egna algoritmen som gjorde att systemet gav fel svar.

Forskarnas rapport dokumenterar inte att sårbarheten existerar i någon av de Road Sign Detection-funktioner som erbjuds idag.

Rapporten heter Robust Physical-World Attacks on Machine Learning Models och finns publicerad på Arxiv (länk).