Volvos mjukvarubolag Zenseact har tillsammans med forskningsinstitutet Cern undersökt om det går att minska beräkningskraften och energiförbrukningen men ändå få förarstödsalgoritmerna att snabbt fatta korrekta beslut. Det treåriga projektet har visat att det fungerar även med så resursbegränsade kretsar som FPGA:er.

Volvos mjukvarubolag Zenseact har tillsammans med forskningsinstitutet Cern undersökt om det går att minska beräkningskraften och energiförbrukningen men ändå få förarstödsalgoritmerna att snabbt fatta korrekta beslut. Det treåriga projektet har visat att det fungerar även med så resursbegränsade kretsar som FPGA:er.

Hur snabbt kan en dator förstå vad den ser utan att tappa i noggrannhet? Och i vilken utsträckning går det att utföra AI-relaterade uppgifter med en hårdvara som har begränsade beräkningsresurser? Det var frågeställningen när Zenseact och Cern drog igång ett forskningsprojekt om maskininlärning (ML) för tre år sedan.

Nu finns resultaten publicerade i två vetenskapliga artiklar som är fritt tillgängliga.

De visar att det går för ML-specialister att designa hårdvaruoptimerade ML-algoritmer som ger låg latens och är energieffektiva men också fungerar i system som måste tåla strålning inklusive Cerns partikelacceleratorer, självkörande fordon och i rymdtillämpningar.

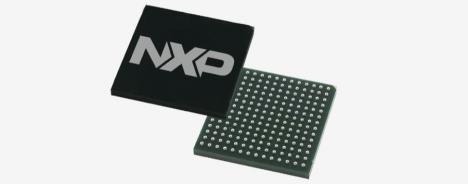

För den praktiska delen av forskningen har gruppen använt ett FPGA-kort från AMD-Xilinx. Det handlar om Xilinx ZCU102 med systemkretsen Zynq som bland annat innehåller en fyrkärnig Cortex-A53, en tvåkärnig Cortex-R5F och en grafikprocessor i form av Mali-400 MP2. Dessutom finns 600k uppslagstabeller, 2520 DSP-block och 32 Mbit minne.

Med en komprimerad version av ENet som togs fram under träningsfasen blev fördröjningen i inferenserna 4,9 ms per bild.

För beräkningarna behövdes bara 18 procent av DSP-blocken, 30 procent av uppslagtabellerna, 6 procent av alla vippor (flip-flop) och 25 procent av blockminnet.

När man istället processade bilderna batchvis, som när de kommer från flera kameror, ökade latensen till 30 ms för batcher med tio bilder vilket är betydligt bättre än att processa dem en i taget.

Slutsatsen är att FPGA:er är ett intressant alternativ till grafikprocessorer för inferenser i deep learningtillämpningar med lägre energiförbrukning och kort latens.

För den som vill gräva djupare i detaljerna finns de två publicerade papperna här:

https://iopscience.iop.org/article/10.1088/2632-2153/ac9cb5/pdf

https://iopscience.iop.org/article/10.1088/2632-2153/ac0ea1/pdf