Det är smartare att använda en klassisk DSP-arkitektur för beräkningar i artificiella neuronnät, än att lansera helt nya parallella arkitekturer. Det anser Cadence och släpper kärnan Tensilica Vision C5, optimerad för ändamålet.

Det är smartare att använda en klassisk DSP-arkitektur för beräkningar i artificiella neuronnät, än att lansera helt nya parallella arkitekturer. Det anser Cadence och släpper kärnan Tensilica Vision C5, optimerad för ändamålet.

Mängder av systemkretsar kan i framtiden komma att ha integrerat stöd för så kallade djupa neuronnät – en klass av algoritmer som gjort att AI-utmaningar som bildtolkning gjort stora framsteg de senaste åren.

Idag slussas ofta sensordata vidare till molnet för AI-analys, medan systemkretsar med C5 och andra kärnor kan tänkas komma att göra åtminstone en del av jobbet själva.

|

| Det blir enklast att hålla sig till arkitekturer man redan känner till, anser Cadence om acceleration av den nya AI-tekniken deep learning. |

Ett exempel är de röstaktiverade assistenter som just nu accepteras som nya medlemmar i allt fler familjer. Ett annat exempel är smarta övervakningskameror som kan känna igen och larma för misstänkta aktiviteter.

Vision C5 lanserades i samband med mässan Embedded Vision Summit, som idag öppnar i San Jose.

En ensam C5-kärna ska kunna leverera en biljon åttabitars-MAC per sekund i en klockfrekvens på 1 GHz och på en yta mindre än en kvadratmillimeter. En MAC (multiply-accumulate) är räkneoperationen att addera produkten av två tal till ett tredje tal.

Tensilica Vision C5 innehåller inte mindre än 1024 stycken åttabitars MAC-enheter att jämföra med 64 respektive 256 i de äldre syskonen P5 och P6 i Vision-familjen.

Den innehåller också 200 nya instruktioner för neurala nät.

Företagets första argument för att använda en DSP istället för någon snäppet mer neuronnätsanpassad arkitektur, är framåtkompatibilitet.

– Vi kollade upp alla de olika arkitekturerna som finns för neurala nät, och de ändras nästa dagligen, suckar Pulin Desai, produktmarknadschef på Cadence.

Deep learning håller fortfarande på att ta form i både algoritmer, precision och topologi, och en programmerbar DSP är framåtkompatibel med de lösningar som i framtiden kommer att utkristallisera sig som mest användbara.

Nästa argument för en DSP-kärna är att den utgör en bekant programmeringsmodell. Som du dessutom ändå inte kommer ifrån eftersom DSP:er måste användas i andra delar av systemet.

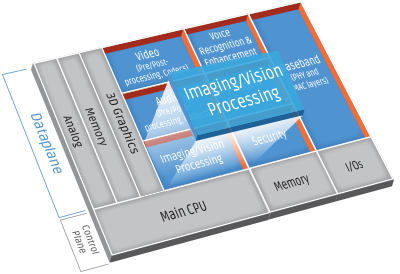

Det tredje argumentet är att eftersom DSP:n kör fler delar av systemet, blir systemet mindre komplext, behöver färre komponenter, drar mindre energi och får högre genomströmning.

Cadence ger som exempel bildigenkänning i ett autonomt fordon. Sensordata kommer från en kamera och genomgår först klassisk bildbearbetning och därefter mönsterigenkänning i flera steg i ett neuronnät.

Cadence tänker sig att en huvud-DSP tar hand om den klassiska bildbehandlingen medan C5 sköter alla steg i neuronnätet. En ANN-accelerator skulle däremot enligt Cadence bara ta hand om vissa av ANN-beräkningsstegen.

DSP:n är till för användning av färdigtränade neuronnät, också kallad inferens, medan programmering av näten fortfarande är något som sker effektivare i serverhallar med en sammalagt prestanda som är upp till 10 miljarder gånger högre än vad en ensam C5-kärna levererar.

En av tillämpningarna är lidar, det vill laserscanning för autonoma fordon och drönare. En annan är sensorfusion. En tredje är övervakning – att automatiskt se vad som händer i övervakningskameran.

C5 ska kunna skalas ner i strömförbrukning till en mobiltelefon eller en wearable, men för dessa tillämpningar finns även Cadence tidigare Vision-kärna P6.

Cadence uppskattar att en självkörande bil skulle behöva kanske tio C5-kärnor medan en bil med ADAS-funktioner eller en smart övervakningskameror, skulle kunna klara sig med en enda.

Vad gäller programmerbarheten så har Cadece verktyg som översätter neuronnäten från standardformat som Caffe och Tensorflow till ett bibliotek av handkodad källkod för C5.