Göteborgsföretaget Embedl bygger om artificiella neuronnät så de blir effektivare – utan att tappa noggrannhet.

Göteborgsföretaget Embedl bygger om artificiella neuronnät så de blir effektivare – utan att tappa noggrannhet.

AI-världens artificiella neuronnät (ANN) växer sig allt större. Att göra en inferens – att be nätet klassificera indata – kan kräva miljarder operationer.

|

| Hans Salomonsson |

– Det tar tid och energi, säger Hans Salomonsson, vd för Embedl, en färsk avknoppare från Chalmers i Göteborg.

Särskilt är de tunga beräkningarna en utmaning i inbyggda system. Där finns ont om beräkningsresurser, det kan finnas realtidskrav och produkterna går ofta på batteri.

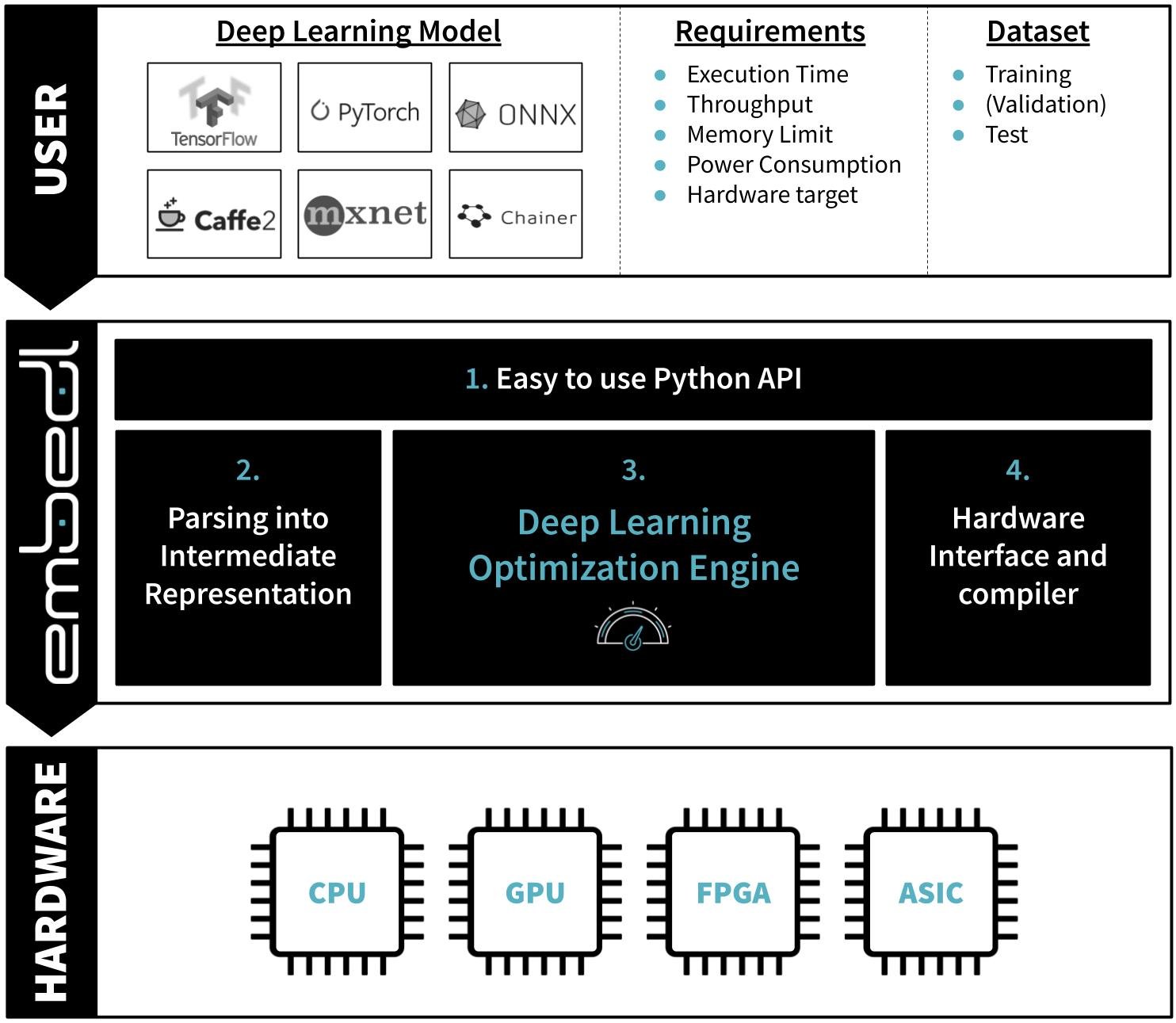

Embedl möter utmaningen med ett unikt verktyg som optimerar neuronnät. Det tar ett befintligt neuronnät och bygger om det till ett nät som beräknar samma funktion för relevanta indata, men kräver färre räkneoperationer.

– Vi ändrar vad som beräknas. Det neurala nätverket blir mer effektivt mot den hårdvara som kunden använder.

Det sistnämnda är viktigt. Att ta bort beräkningar kan i värsta fall till och med göra ett neuronnät långsammare. Därför måste koden optimeras efter den specifika hårdvaran.

Embedl stöder flera olika hårdvaror vilket betyder att kunden kan utvärdera dem mot varandra, vilket är ytterligare en viktig poäng med verktyget.

Elektroniktidningen försöker på tusen sätt pumpa Hans Salomonsson på exakt hur Embedl tråcklar med neuronnäten för att effektivisera dem. Men han tiger.

– Det är det som är ”the secret”, skrattar han.

Inga detaljer nämns i EU-projektansökningar. Ingen gammal forskningsrapport avslöjar något.

– Vi har valt att inte publicera något.

Kunder är Embedl mer öppen mot, så är du kund vet du mer.

– Lösningen är inte en black box mot kunderna.

Embedl är inte ensamt om idén i sig, att effektivisera neuronnät. Det är ett populärt forskningsfält. Företaget använder alla kända knep, utöver sin egen specialare.

Det mesta av denna artikel är tidigare publicerat i magasinet Elektroniktidningen. Det mesta av denna artikel är tidigare publicerat i magasinet Elektroniktidningen.Prenumerera kostnadsfritt! |

Det kan gå att sänka precisionen i de interna beräkningarna på hela eller delar av näten utan att utdata påverkas dramatiskt. Det kan till och med gå att klippa bort delar av nätet.

– Det kallas pruning. Det handlar om att leta efter och ta bort redundans.

– Men pruning i sig självt är ganska begränsat i hur mycket det ändrar i nätet. Vi kan göra större förändringar.

Det problem som Embedl löser är i grunden konflikten mellan precision och effektivitet. För att öka precisionen på nätet adderar man typiskt operationer, men då tar beräkningarna som resultat längre tid.

– Vi kan säga till kunden att de kan fokusera på noggrannheten så tar vi hand om latensen.

Embedl stöder neuronnätskretsar från Nvidia, Arm, Intel, och Xilinx. Och till hösten även Qualcomm. Att ta fram stöd för en ny arkitektur tar 1–2 månader. Kundernas efterfrågan styr fokus.

Tillämpningsområdet för Embedls tre kunder är datorseende. Det är det område där ANN är störst idag.

– Speech och text kanske kommer senare.

Företaget har elva anställda varav åtta ingenjörer, alla inom mjukvara.

– Vi behöver inte förstå hur hårdvaran fungerar, bara veta vad som är effektivt.

I slutet av 2023 hoppas de vara fyrtio.

– Det finns jättemycket att fortsätta utveckla. Hur man bygger nätverken, tränar dem, optimerar dem och så vidare.

– Forskningen är inte färdig på något sätt. Särskilt när det handlar om att få dem effektiva i inbyggda system.

Den kund som Embedl jobbat längst mot är Zenseact, Volvos dotterbolag för AD- och ADAS, och leverantör till hela Geelykoncernen.

Kund nummer två finns inom försvarsteknik – Saab. En tredje kund är inte offentlig, men har sin verksamhet inom varuhandel.

Saab och Zenseact är idealkunder. Där finns expertis som utvecklar egna neuronnät. Därefter kan de på egen hand använda Embedls verktyg – Neural Compression SDK – för att trimma sina nät.

– Den affärsmodellen är skalbar.

Vad gäller den tredje kunden inom varuhandel har Embedl snarast fått fungera som konsult och leverera en totallösning, inklusive att utveckla modeller.

Företaget vill egentligen inte vara konsult utan ett bolag som säljer en produkt och levererar tillhörande tjänster.

Neural Compression-produkten kan mycket väl komma att följas av fler.

– Vi har fler verktyg i pipeline. De handlar om att bygga effektiva neurala nät.

Den röda tråden är att hjälpa kunden att ta deep learning från utvecklingsstadiet till en skarp produkt.

– Vi hjälper kunder inom inbyggda system att produktifiera AI.

Han har tre smarta idéerEmbedl har fått finansiering från EU, Vinnova, Almi, VGR och privata investerare. En ny finansieringsrunda är just nu öppen.

Företaget har medverkat i två forskningsprojekt under EU:s program Horizon 2020: LEGaTO och VEDLIoT. Veoneer och Siemens är partners i EU-projekt. Ett Vinnovaprojekt gjordes tillsammans med Högskolan i Halmstad och Volvo Group. Grundarna Hans Salomonsson och professor Devdatt Dubhashi har ett bolag tillsammans som heter Machine Intelligence Sweden. Där är Embedl dotterbolag. Syskonbolaget Repli5 genererar syntetiska träningsdata i grafikmotorn Unreal Engine. Motorn används normalt för att skapa datorspel, men den är så pass realistisk att den kan generera scener som det går att träna neuronnät på. Det finns en tredje affärsidé i moderbolaget, men den ligger i dvala: att knyta samma forskare med bolag, med hjälp av en AI-baserad sökmotor. – Det här är något jag vill komma tillbaka till. Där finns jättemycket att göra. Jag har varit både inom akademi och industri och det skulle behövas en ny modern brygga mellan dem. – Men det får kanske bli en annan livstid, skrattar Hans Salomonsson. – Det jag gör nu tar upp min tid gott och väl. |

Artificiella neuronnät,

|