REPORTAGE Snart är den slut, AI Mee, en treårig öppen testbädd inom robotik och autonoma system på Örebro universitet. Men sörj inte, för labben permanentas och projekten går vidare under ny flagg.

REPORTAGE Snart är den slut, AI Mee, en treårig öppen testbädd inom robotik och autonoma system på Örebro universitet. Men sörj inte, för labben permanentas och projekten går vidare under ny flagg.

Utbytet av testbädden blev överraskande brett, enligt koordinatorn Amy Loutfi, professor i datavetenskap på Örebro universitet.

– Det blev en större spridning av industriella tillämpningar i AI Mee än vi hade trott. Det blev en aptitretare som demonstrerade vilka stora möjligheter som finns i regionen.

Amy Loutfi lyckas klämma in ett telefonsamtal med Elektroniktidningen, trots att hon är tyngd under sitt arbete i omstartskommissionen efter corona.

– Det här är verkligen en intensiv arbetsperiod, pustar hon under promenaden till nästa möte.

Hon sitter i kommissionen i egenskap av ”Sveriges främsta expert inom digitalisering”.

AI Mee är ett ”autonomi-för-alla”-initiativ. Företag som undrar om de möjligen kan ha ett utbyte av robotar, AI, simulering, cyberfysiska system och så vidare, kan knyta kontakter med forskare och besöka universitet för demonstrationer, i alla fall när corona tillåter det.

– Vårt robotlabb har fungerat som ett utmärkt verktyg för att kommunicera vad det är vi håller på med på universitetet. AI och autonoma system är annars områden som kan vara svåra att förklara – de framstår lätt som ren science fiction. Det är svårt att förstå vad som konkret är möjligt att göra.

– Kanske en av de största effekterna blev en ökad medvetenhet om vilka möjligheter som finns inom autonomi.

Ett tiotal tillämpningar kom till stånd – se faktarutan nedan.

Nådde ni dem ni ville nå?

– Ja och nej. Vi hittade många inom en stor del av den privata sektorn. Men vi ser att det finns kvar en grupp privata företag med stor potential – de som utför arbeten inom exempelvis sjukvård och kommun.

Ett projekt på Kopparbergs bryggeri med utbildning i utökad verklighet, är ett av dem som ser ut att komma att tas i skarpt bruk.

På forskningssidan har AI Mee bland annat fått en publicering i den viktiga tidskriften Automatica för ett projekt med MH Engineering och en fjärrstyrd robot i en påfrestande arbetsmiljö.

Labben och andra strukturer som byggts upp inom AI Mee blir kvar. Verksamheten fortsätter inom ett regionalt projekt kallat AI Impact lab som är en av noderna i Sveriges nationella AI-center, AI Innovation of Sweden.

Lärdomar och läxor?

– Underskatta inte inlärningskurvan som krävs. Företaget behöver ha en långsiktig vision. Vi är inte här bara för att det är kul att göra en implementering, det måste finnas en nytta och det måste ledningen förstå.

Större företag har lättare för detta. Men det kan vara en utmaning för mindre och mellanstora företag.

– Vilket är synd, för det är de som kan ha den största nyttan av ett utbyte.

Hur mötte ni den utmaningen?

– Genom relationsbyggande. Trots att ämnet är robotar, har i praktiken mycket hårt jobb handlat om att möta människor, bygga relationer och vinna förtroende.

I ledningen för AI Mee sitter även den regionala hubben Alfred Nobel Science Park.

– Vi har haft ett fantastiskt bra lag! Det är kanske precis den mix som behövs för något sånt här – science park och ett universitet. Det betyder att man måste vara beredd att gå utanför sin bekvämlighetszon, men det skapar spännande möjligheter.

AI hittade till ÖrebroArtificiell intelligens, robotik och cyberfysiska system – det är de genomgående teman Elektroniktidningen ser inom AI Mee. Här är ett urval av de projekt som initierats sedan AI Mee startade år 2017. Robotar bär plantor En Wall-e-liknande robot på hjul med griparmar från amerikanska Harvest Automation vid namn Omniveyor HV-100, flyttar till vardags runt krukor på plantskolor för att ge dem utrymme allteftersom de växer. I projektet Agtech har den utrustats med det öppna robotoperativsystemet Ros och ska lära sig fler yrkesfärdigheter – kanske lagerarbete – och hitta arbetstillfällen i regionen.

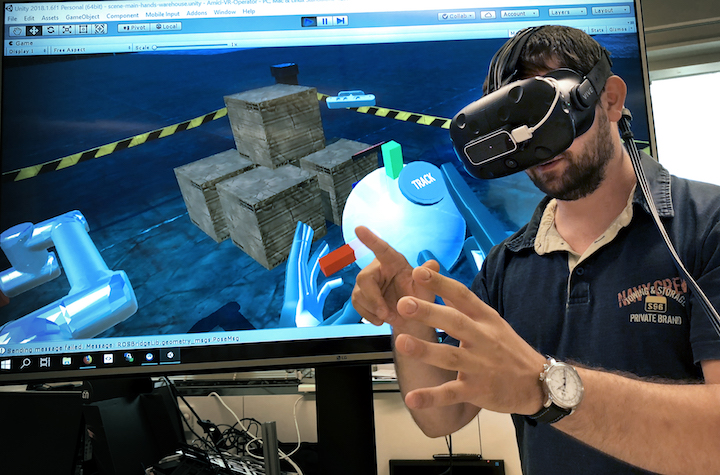

Robotar tar smutsiga jobb Autohic är ett experiment i fjärrstyrning av industrirobotar i tuffa miljöer. Partner är MH Engineering i Karlskoga som idag manuellt gör termisk höghastighetssprutning av värmepannor – bullrigt, tungt, smutsigt, hälsovådligt. Styrningen görs i en semi-virtuell värld där en operatör med VR-glasögon styr roboten med sina egna händer. Robotar odlar Lomas är en autonom växtbädd för småskalig odling som hanterar sin egen sådd, bevattning, ogräsrensning, gödsling och luckring med hjälp av sensorer och en robotarm. Den använder AI för skördeoptimering och är tänkt för restauranger. Robotar blir gruvarbetare Gruvteknikföretaget Epiroc vill evakuera gruvans riskzoner på människor och ersätta dem robotar, fjärrstyrda eller autonoma. AI Mee har tagit sig an borrmaskinen Boomer. Den har flera armar, som en bläckfisk, men Epiroc har problem att koordinera armarna och vågar bara använda en i taget trots att hundratals spränghål ska borras. Koordineringen kan hanteras av en sorts virtuell trafikpolis. Ytterligare en utmaning är att hantera oförutsedda händelser.

Cyberkopia av kulturkvarter Ett byggprojekt i Örebro, Kulturkvarteret, ska få en digital tvilling – en synkad datormodell av byggnaden och dess innehåll, inklusive besökare. AI och simuleringar på tvillingen ska användas för att optimera upplevelsen för besökarna. Forskarna har bland annat hittat en generell lösning på integritetsproblemet med att modellera enskilda besökare. Hololens handleder Sommarjobbare på Kopparbergs bryggeri kan komma att inskolas med en Hololens – Microsofts skärmglasögon för augmented reality. Hololens kommer att guida dem till rätt handhavande när de exempelvis bygger om ett löpande band. Glasögonen filmar det operatören tittar på och Hololens adderar instruktioner till skärmbilden. Projektet heter Augmentor. AI ska anpassa gränssnittet till användaren. Simulerar fabrik Projektet F2 SIM simulerar produktionsflödet på en industri, inklusive människor, maskiner och transport. Med hjälp av AI struktureras och organiseras arbetsytorna för maximal produktivitet. Projektet drivs i samarbete med Kåbe-mattan. |

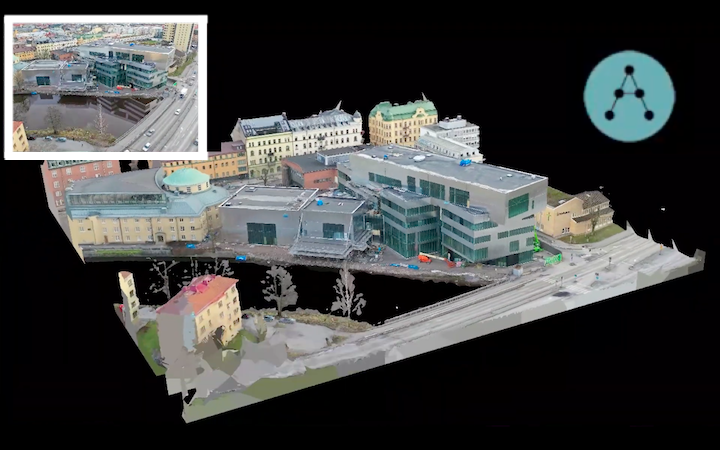

Bättre kartor när robotar ritar tillsammansTvå autonoma robotar ritar tillsammans upp en semantisk 3D-karta över Örebro universitet. Deras sensorer och maskininlärning fyller vita fläckar på kartan. Klassisk AI gör en rimlighetskoll och sammanställer. En rullande robot vill parkera och ber sin kompis flygdrönaren om hjälp. Den ser en ledig parkering bakom en byggnad – och noterar den på deras gemensamma 3D-karta. Så kan det se ut när två robotar tillsammans bygger upp en gemensam karta över miljön. Robotar som hjälper varandra att orientera sig är ett av Martin Längkvists intressen. Han forskar i maskininlärning på Centrum för tillämpade autonoma sensorsystem (AASS) på Örebro universitet. De två robotarna har olika typer av sensorer och befinner sig dessutom på olika platser med olika vyer. En gemensamt ritad karta kan därmed bli mer komplett. – Utmaningen är hur resultaten från robotarna ska sättas ihop, berättar Martin Längkvist. Idén med att sammanställa sensordata från flera robotar för att få bättre omvärldsinformation är inte ny. Ett sätt är att använda så kallad registrering. Robotarna kan exempelvis bygga varsitt så kallat 3D-punktmoln från sina lidarsensorer och sedan geometriskt transformera dem till ett enda tätare moln. Martin Längkvists robotar bygger istället upp en gemensam semantisk 3D-karta. En sådan visar miljön uppdelad i identifierade objekt, som bil, buske, abborre, elkabel och så vidare. Och nu är vi framme det unika i just Martin Längkvists robotar: hur de gör för att identifiera objekten i kartan. De använder maskininlärning – som alla nuförtiden – men dessutom låter de klassisk AI få ett ord med i laget. De litar inte blint på sin maskinklassificering utan de adderar lite sunt förnuft och logik för att göra klassificeringarna rimligare. Tekniken kallas närmare bestämt KRR (kunskapsrepresentation och -resonemang) och används på flera sätt i kartläggningen. – KRR används för att rätta till felklassificeringar, annotera data som används för träningen av klassificerarna, peka på utstickande data, fylla i saknad data, med mera. Den här typen av hybridlösning av maskininlärning och KRR är ovanlig. – Det har varit efterlängtat länge och många forskarlag har föreslagit olika lösningar, men ännu är det oklart vilken som är den bästa. I Martin Längkvists första experiment ritas kartan av en flygande drönare och en ombyggd gräsklippare – mobila robotar i luften och på marken. De använder vanliga RGB-kameror. Rullboten har dessutom lidar. 3D-punktmolnet hanteras med hjälp av programvaran Reality Capture. – Vi testar att rita upp en semantisk karta av omgivningen, i detta fall runt Örebro Universitet, med hjälp av robotar som har olika synvinklar. Drönaren har översikt och den rullande markroboten ser detaljerna. – Tanken är att lösningen som vi eftersträvar ska vara generell oavsett antal farkoster och typ av sensorer. Men vi har inte testat den på mer än två farkoster på land hittills. En av de rent tekniska utmaningarna har varit att hantera 3D-punktmolnen. – Oftast används punktmoln inomhus och på mindre möbler och objekt. Men här används ett punktmoln som beskriver en komplett utomhusbyggnad – över 20 miljoner datapunkter. Att experimenten sker på land är för att det är enklare och billigare än det som egentligen är slutmålet: undervattensfarkoster. Att testa på land är ett sätt att snabbt komma igång. Saab Dynamics är partner i projektet och hoppas att det ska appliceras på dess autonoma undervattensfarkoster. I det fallet kan det exempelvis vara ett ytfartyg som upptäcker något på ekolodet som ska kommuniceras till en autonom undervattensfarkost, som kanske söker efter något, eller kartlägger eller reparerar en kabel. Martin Längkvist tror att han ganska snart kan vara mogen att fortsätta under vattnet. En teknisk förändring blir då att lidar och kamera måste bytas ut mot andra typer av sensorer. Arbetet sker i ett projekt som heter Corob (cooperating robots) som i sin tur är en del av testbädden AI Mee (testbed for autonomous intelligent machines for enterprise and exploration). – Målet har inte varit att göra en färdig algoritm för implementering utan mer att utforska nya algoritmer och metoder för nya utmanande tillämpningsområden, samt att inspirera och få fler företag att se potentialen med forskning kring AI. Martin Längkvist blev civilingenjör i teknisk fysik på Linköpings universitet och doktorerade i informationsteknik på Örebro universitet. Han har bland annat jobbat med tidsserieanalys, klassificering av satellitbilder och bildmedicin med hjälp av maskininlärning. – Jag har alltid varit intresserad av lärande och hur vi människor lär oss saker och varit fascinerad över om och hur vi kan applicera denna kunskap och metoder på robotar. |