Händelsekamerans extrema prestanda har gett den ett antal industritillämpningar. Men tekniken väntar ännu på massvolymer.

Händelsekamerans extrema prestanda har gett den ett antal industritillämpningar. Men tekniken väntar ännu på massvolymer.

Artikeln är tidigare publicerad i magasinet Elektroniktidningen. Artikeln är tidigare publicerad i magasinet Elektroniktidningen.Prenumerera kostnadsfritt! |

Så kallade händelsekameror är snabbare, strömsnålare och har bättre omfång i ljusstyrka än klassiska kameror.

Skillnaden är stor. För sina typiska tillämpningar genererar de mycket mindre datatrafik och kräver mycket mindre beräkningskraft i efterbearbetningen.

Läs faktarutan nedan om du vill lära mer om den fascinerande tekniken!

I slutet av 2019 vaknade ett nytt intresse för händelskameror när Samsung och Sony gjorde investeringar. Att dessa jättar nu finns bland intressenterna tryggar att det finns muskler och beredskap att svara om efterfrågan på tekniken till sist skulle hitta en massmarknad och gå upp i volym.

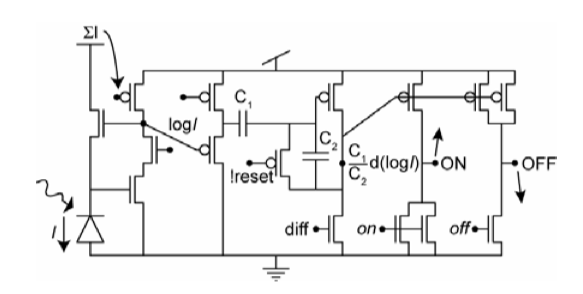

Tekniska högskolan ETH i Zürich har under ett drygt decennium varit ett centrum för utvecklingen. Där finns bland annat professor Tobi Delbruck som är hjärnan bakom en fotocellkonstruktion publicerad 2005. Flera av de kommersiella företagen har sagt att de använder den – och resten ”har inte erkänt” att de gör det, om man får tro Tobi Delbruck.

|

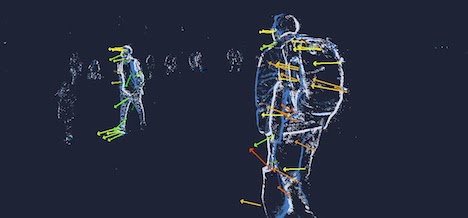

| Händelsekamerasensorn utvecklades på Zürichs universitet på 00-talet. Pixelfotocellen triggas när derivatan på ljusflödet passerar ett tröskelvärde. |

Han kallar händelsekameran för en kiselnäthinna eftersom han inspirerades av hur ögon fungerar. Nyckeln till naturens effektivitet är att ögat bara rapporterar till hjärnan när nåt händer, påpekar han. Det finns ingen ”bildfrekvens” i människans seende.

EN HANDFULL FÖRETAG utvecklar händelsekameror. Flera är avknoppningar från ETH Zürich.

Forskningen går vidare, exempelvis med den stora trenden inom bild generellt idag: maskininlärning.

Den första utmaningen där är att händelsekameran inte alstrar bilder alls som rådata. Problemet har lösts med hjälp av andra neuronnät som konverterar koordinatströmmen till bilder som är tillräckligt fotoriktiga för att bildigenkänningsnäten ska reagera på dem.

Utöver att göra händelsekameran kompatibel med existerande maskininlärningsalgoritmer, utvecklas nya algoritmer som forskarna hoppas kan vara ännu effektivare. Rådata från händelsekameran är komprimerad – den bjuder på en sorts analys genom att peka ut det viktiga i en scen.

Kameraövervakning är ett uppenbart exempel på en tillämpning för en händelsekamera. Användaren vet redan hur scenen ser ut. Hen är bara intresserad av att få en rapport när nåt händer.

Samsung lanserade en övervakningskamera i sin smarta hemportfölj år 2019. På Dustins webbutik kostar den tusen kronor idag. Trådlös, Mikro USB-matad, 34 gram, driven av en strömsnål Cortex A-fyrkärna i 14 nm av årsmodell 2014.

Produkten stoltserar med sin ljuskänslighet och adderar dessutom moderna AI-tillämpningar, som att kunna skilja mellan hunden och en inbrottstjuv, och att kunna detektera fall.

|

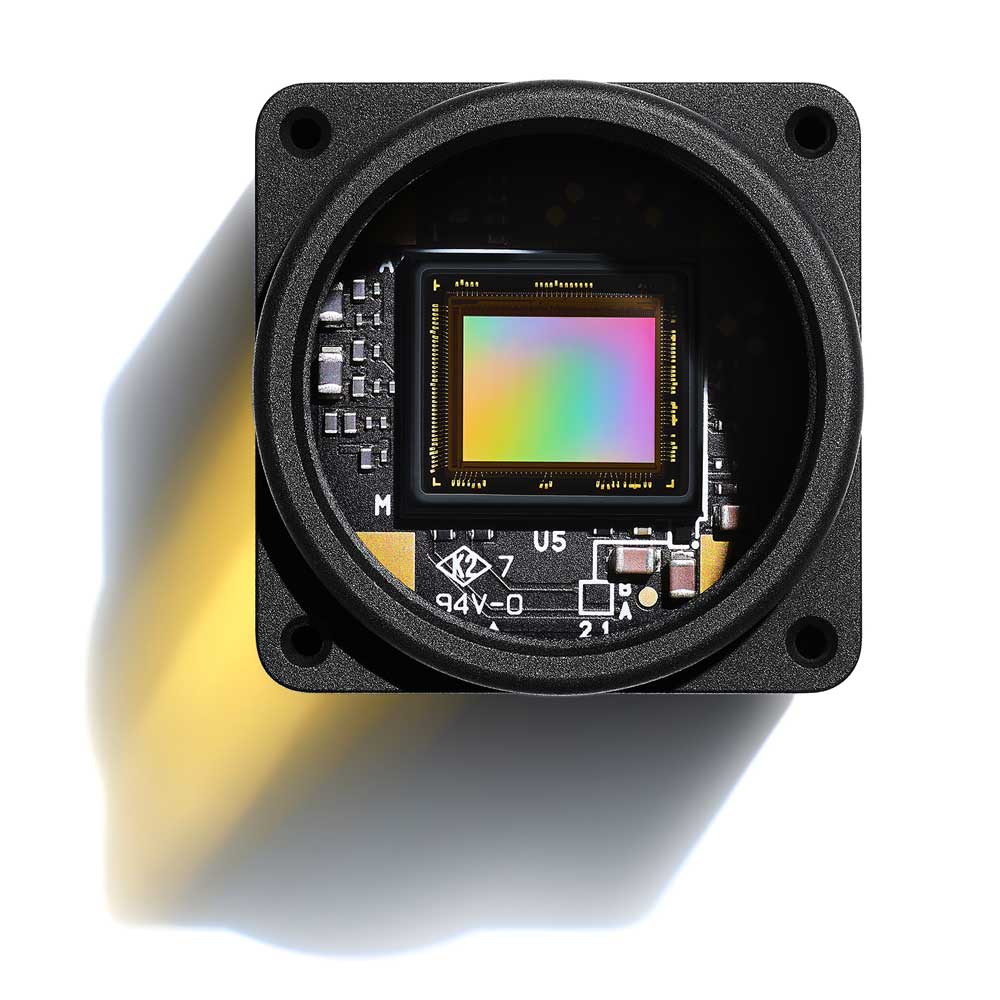

| Det finns kommersiella produkter, men ingen har blivit en storsäljare. Här är en hemmakamera från Samsung. |

DESSUTOM BEVARAR den personlig integritet bättre än en klassisk kamera, tycker Samsung, eftersom rådata bara är konturer av objekten i bild, på grund av hur händelsekameror fungerar.

Händelsekameror är snabba. Tidsupplösningen motsvarar en klassisk kamera som tar tiotusen bilder per sekund. År 2019 spelade Zürichforskarna in video i 5200 bilder per sekund från en händelsekamera.

Som jämförelse kan de bästa mobilkamerorna från Huawei ta 1920 bilder per sekund.

Samma telefoner kan därefter spela upp videon i 7680 fps.

DE FUSKAR VISSERLIGEN – de interpolerar från 1920 fps och kan bara fånga 120 millisekunder innan minnet är fullt. Men det demonstrerar händelsekamerans kommersiella dilemma. Inte ens super-slowmotion i konsumentprodukter kräver uppenbarligen händelsekamera.

Så länge som ”bra” är tillräckligt, spelar det ingen roll om händelsekameran är bättre.

På en självflygande drönare kan händelsekameran hjälpa drönaren att positionerna sig i luften, inklusive att hålla den svävande även om en rotor faller ifrån. Dessutom kan den snabbt peka ut en boll som kastas mot den, så att drönaren kan hinner väja undan. Alla tre är exempel från forskningen på ETH.

Att hantera rotorfrånfallet lyckades forskarna med, även med styrning från en konventionell kamera. Men händelsekamerans reglering är snabbare och fortsätter dessutom att fungera i svagt ljus när den konventionella kameran till sist kapitulerar för rörelseoskärpa.

Så kanske drönarstyrning kan bli det breda genombrottet för händelsekameran?

Den berömda Marshelikoptern orienterar sig efter en kamera och en av ETH-forskarna hjälpte faktiskt till med att skriva programvaran. Så i en framtida Marsresa kanske helikoptern har en händelsekamera? Med de kortare reaktionstiderna utlovas flygegenskaper som nästan är som en fluga. Då kanske drönarna vågar sig på att navigera i Mars lavatunnlar, som kan vara avgörande för en eventuell kolonisering av Mars.

Även från militären finns ett intresse. Amerikanska forskningsorganet Darpa vill bland annat bygga en smart händelsekamera för IR-ljus på max 1,5 watt för ”taktiska tillämpningar”.

Så funkar händelsekamerorInspiration från ögon

Händelsekameror levererar inte fotografier som rådata. Det är inte vad de primärt är till för, även om dataströmmen numera kan konverteras till fotografier med hjälp av AI. Deras specialitet är att detektera förändring. De reagerar på förändringar i ljusstyrka. Sensorytan är täckt av vad vi kan kalla digitaliserade fotoceller. Dagens högsta kommersiella upplösning är 1280 x 720 celler. Oberoende av varandra bevakar cellerna varsin punkt i bilden. Elektroniken triggas när ljusflödet ändras bortom ett tröskelvärde. När punkten blir mörkare eller ljusare, aldrig annars, lägger cellen på en mikrosekund ut ett tidsstämplat datapaket på databussen med de egna koordinaterna.

KONVENTIONELLA filmkameror rapporterar samtliga punkters ljusintensitet minst 24 gånger i sekunden. Oavsett om något ändrats. Samtidigt som det i någon annan del av bilden kanske skett en förändring för snabbt för att ens hinna registreras i den aktuella bildfrekvensen. Händelsekameror har ingen bildfrekvens. Varje cell rapporterar oberoende av de andra och i princip kontinuerligt. Analysen av var det sker en förändring i scenen är därmed gratis medan ett konventionellt kamerasystem behöver jämföra efterföljande bilder och söka efter skillnader för att peka ut förändringar. NÄR ETT OBJEKT rör sig i bild ändras minst två pixlar i händelsekameran, en pixel blir ljusare och en blir mörkare. I rådata syns en kontur av objektet om det är homogent belyst eftersom mellanliggande punkter har samma ljusstyrka. Händelsekameror kan blixtsnabbt dokumentera förändring i en scen. På en mikrosekund i dagens teknik. Den pekar på vad som rör sig eller tvärtom – hur kameran själv rör sig relativt världen när den används för navigering. Det går förmodligen tekniskt att öka dynamiken bortom de 120 dB som Prophesee valt för sin senaste kamera. Konventionella kameror ligger på upp till 80 dB. Bilden ovan: Schweiziska Prophesees sensor i en industrikamera från japanska Century Arks |

Zürichavknoppare säljer till industrinHär är företagen som kommersialiserar tekniken idag

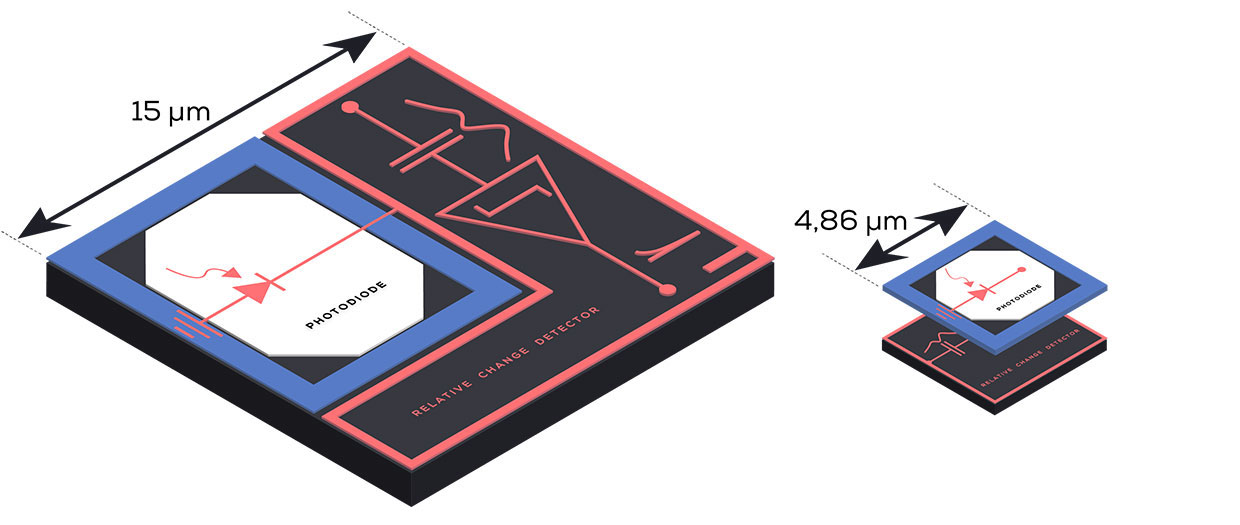

Händelsekameran har hittat industriella tillämpningar där den extrema prestandan gör skillnad. Här är några av de kommersiella aktörerna. Den just nu vassaste sensorn släpptes av franska Prophesee i fjol. Sony hjälpte till att lyfta elektroniken. En tvåchipslösning rensade upp kring fotodioderna som därmed kunde dra ner sin pitch från 15 till 5 mikrometer. Elektroniken som triggar vid ljusstyrkeförändring sitter nu bakom fotocellerna i ett eget chip.

Sensorn loggar upp till en miljard pixelhändelser per sekund. Den drar 32 mW vid 100 000 händelser per sekund och 73 mW vid 300 miljoner. Upplösningen är 1280 × 720. Den dynamiska räckvidden i ljusstyrkan anges som större än 120 dB, 20 bitar. Har du produktidéer är du välkommen att beställa en kamera från Prophesee och börja experimentera. Företaget bjuder på öppenkod som inkluderar träningsdata, 100 algoritmer, 67 kodexempel och elva tillämpningar. Det som företaget producerar idag är kameror och algoritmer för specifika industriella tillämpningar, gärna på uppdrag. En kamera från nämnda Prophesee räknar piller, fröer, muttrar och annat som passerar framför kameran. Imponerande tusen saker i sekunden kan systemet räkna. En klassisk kamera behöver ta tiotusen bilder i sekunden för att klara detta. Sensorn har VGA-upplösning och hjärnan är en vanlig mobiltelefonprocessor. En annan tillämpning från samma bolag att är filma hur en maskin vibrerar för preventivt underhåll – slitage manifesterar sig i en ändrad rytmik. Svenska Terranet utvecklar mjukvara för en sensor för förarassistans och självkörning. Den 3D-kartlägger omgivningen med hjälp av tre händelsekameror och en laser som sveper över miljön. FLER ÄN TERRANET tror på händelsekameror i fordon. Den höga dynamiken betyder att kameran fungerar bättre i motljus, tunnlar och andra kontrastrika scener. Trafikljus och bromsljus framstår tydligt medan deras 100 Hz-blinkande är en utmaning för konventionella kameror. Med mera. l Amerikanska Xperi har ett förarövervakningssystem som noterar vart blicken går, hur huvudet är orienterat och hur ögonlocken faller. Systemet identifierar dessutom föraren. Schweiziska Insightness – sedan i fjol dotterbolag till Sony – har utvecklat drönarstyrning som kan undvika kollisioner med andra rörliga objekt. Det går att beställa en utvecklingssats. Taiwanesiska Omnivision saluför en sensor och tipsar bland annat om att den skulle kunna användas för geststyrning. Schweiziska Inivation har en lösning för blickföljning i AR-glasögon och VR-hjälmar. Latensen är 3 ms. En tillämpning är att systemet renderar grafik i hög upplösning endast i den punkt där användaren tittar. Inivation erbjuder även snabb 3D-scanning för exempelvis kvalitetskontroll och robotstyrning. |