Brittiska Graphcore släpper hårdvara för AI-acceleratorsystem skalbara från en petaflops till 16 exaflops. Graphcore säger sig ge en magnitud högre prestanda per krona än den senaste Nvidiahårdvaran i samma TSMC-process.

Brittiska Graphcore släpper hårdvara för AI-acceleratorsystem skalbara från en petaflops till 16 exaflops. Graphcore säger sig ge en magnitud högre prestanda per krona än den senaste Nvidiahårdvaran i samma TSMC-process.

|

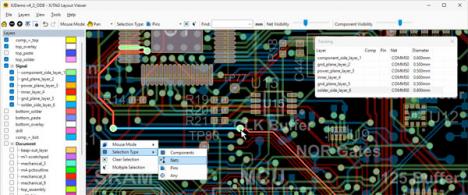

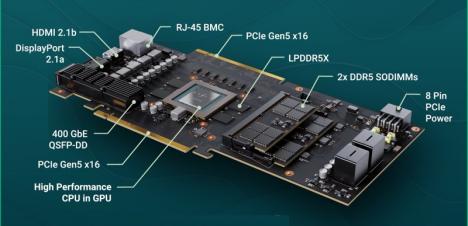

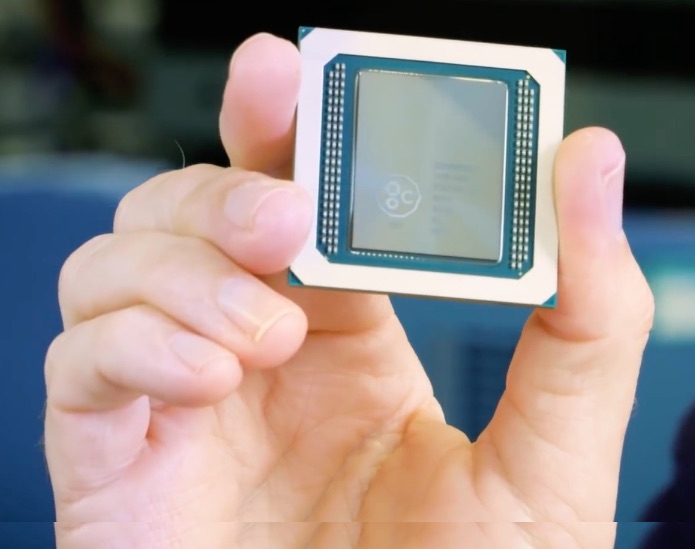

Fyra stycken GC200 ger kortet MC2000 en maxprestanda på en petaflops. . Fyra stycken GC200 ger kortet MC2000 en maxprestanda på en petaflops. .  |

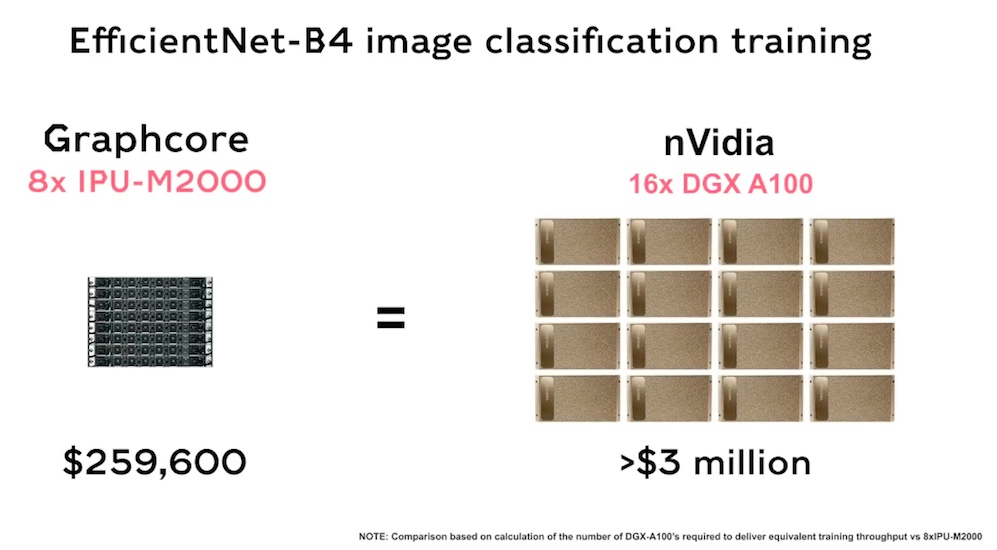

| Graphcore lovar maskininlärningsprestanda som mäter sig med Nvidas grafikkort, men till betydligt lägre kostnad. |

Tillämpningen är framför allt maskininlärning, det vill säga kalibrering av djupa artificiella neuronnät, något som idag huvudsakligen görs i grafikkort från Nvidia, eller i egenutvecklade kretsar och system hos stora användare som Google.

Ett system med åtta exemplar av Graphcores kort MPU-2000 ger samma prestanda vid maskininlärning som 16 exemplar av Nvidias kort DGX A100 till en tiondel av kostnaden – 260 000 dollar mot drygt tre miljoner dollar. Exemplet gäller träning av det djupa neuronnätet EfficientNet-B4.

Det hävdar i alla fall Graphcore och jämförelsen är delvis teoretisk. Nvidia kommer säkerligen att presentera sitt eget perspektiv.

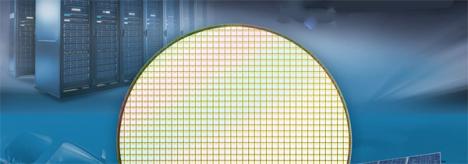

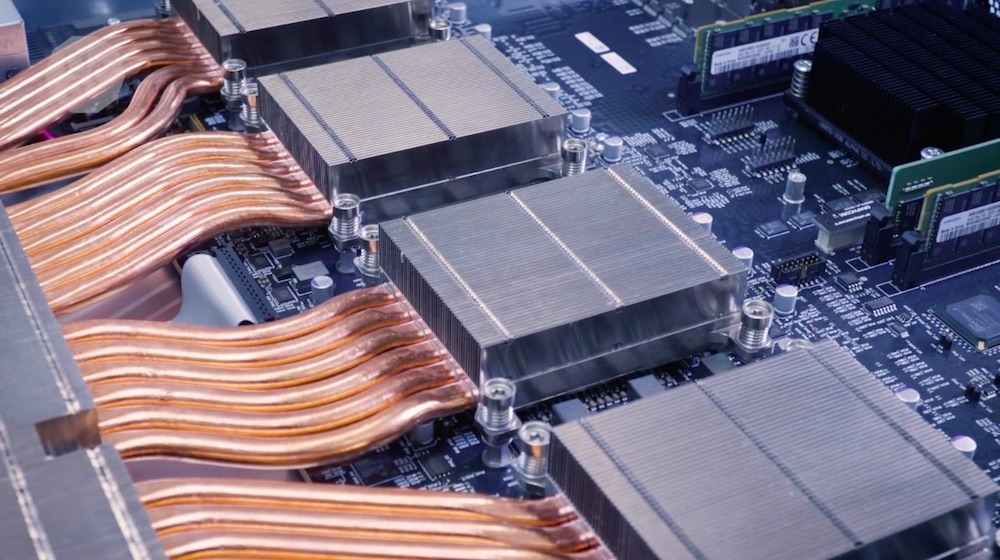

Båda systemen är dock byggda av kretsar som släppts nu i sommar, snarlika i storlek och båda tillverkade i TSMC:s FinFET-process i 7 nm. Graphcores krets GC200 består av 59 miljarder transistorer på en yta av 823 kvadratmillimeter. Som jämförelse består Nvidiakretsen GA100 av 54 miljarder transistorer på 826 kvadratmillimeter.

Det konkreta erbjudandet från Graphcore är system byggda kring acceleratorkortet MPU-2000 som består av fyra exemplar av GC200 och har en teoretisk maxprestanda på en petaflops. Kortet kan byggas samman till system i storlekar teoretiskt ända upp till 16 exaflops – för en halv miljard dollar om Elektroniktidningen räknar rätt.

GC200 är optimerad från grunden för maskinlärning. Den består av 1472 oberoende processorkärnor med sammanlagt 8832 parallella beräkningstrådar. Kärnorna har lokala minnen med en sammanlagd storlek på 900 Mbyte.

Men det som Graphcore framhäver mest är den minnesarkitektur och den nätverksteknik – den senare utvecklad i Oslo av tidigare hårdvarukonstruktörer på Sun – som systemlösningen använder.

Via minnessystemet Exchange Memory adresserar processorn upp till 450 Gbyte externt DDR4-minne med en bandbredd på 180 Tbyte/s. Förbindningstekniken heter IPU-fabric och har en aggregerad bandbredd på flera petabit/s.

Graphcore bildades år 2016 efter att Google avslöjat att det hade egenutvecklade maskininlärningskretsar i bruk. Den totala summan av investeringar i Graphcore ligger hittills på 460 miljoner dollar. Första generationen kretsar från Graphcore tillverkades i 16 nm och har kunnat provköras i Microsofts moln Azure sedan november.

Graphcores neuronnätsaccelerator GC2000 har 54 miljarder transistorer.

Graphcores neuronnätsaccelerator GC2000 har 54 miljarder transistorer.